使用 LM Studio 本地 AI 服务

Pixcall 同步资源库和纯本地资源库都可以使用 LM Studio 本地 AI 服务,来完成文件的智能分析、智能搜索、智能标签、智能描述、智能移动文件夹等功能。您可以按如下步骤启用 LM Studio 本地 AI 服务:

第一步:下载并且启用 LM Studio 客户端

Section titled “第一步:下载并且启用 LM Studio 客户端”- 进入 LM Studio 官网下载页面,下载适合您当前操作系统的 LM Studio 客户端。

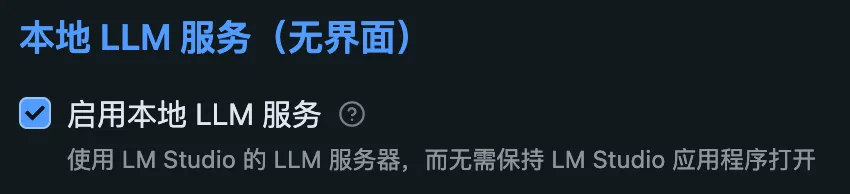

- 安装完成后,打开 LM Studio 客户端,在 Settings > Developer 启用本地 LLM 服务。

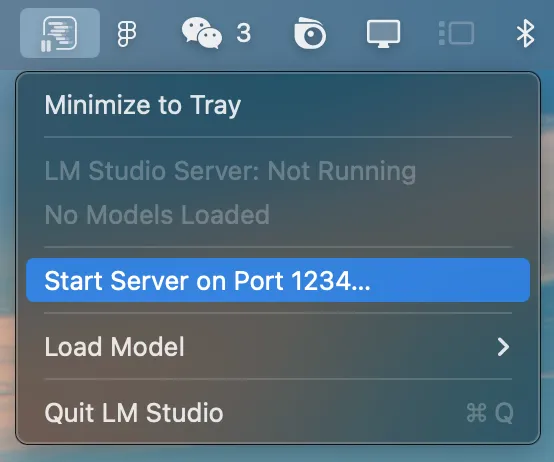

- 确保在 Pixcall 使用智能服务时,LM Studio 的 本地 LLM 服务处于运行状态(状态栏的 LM studio Server 处于运行状态)。

第二步:在 Pixcall 中启用 LM Studio 服务

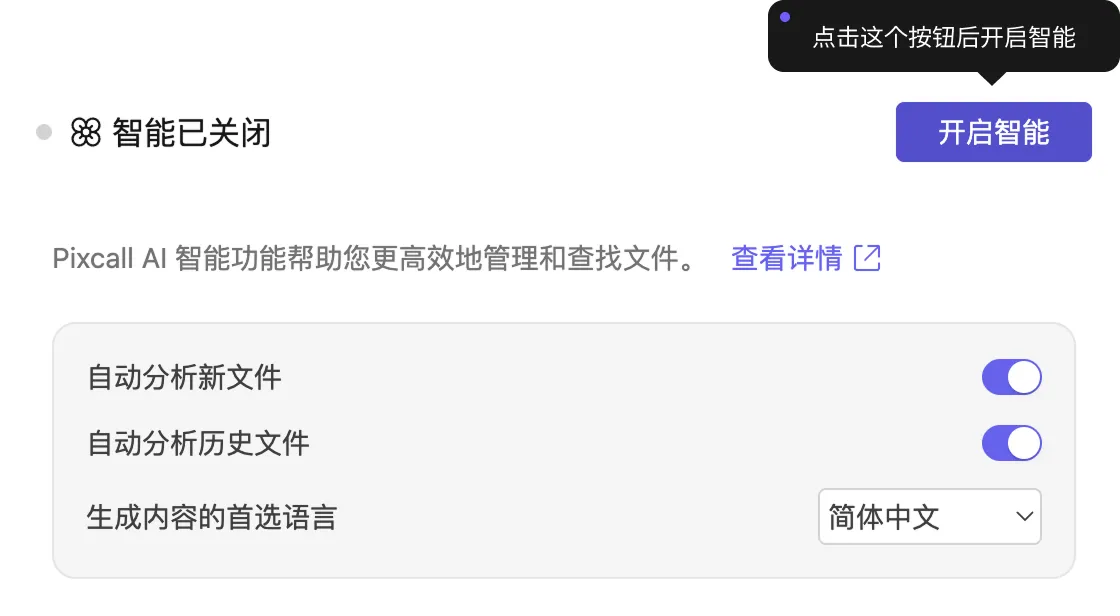

Section titled “第二步:在 Pixcall 中启用 LM Studio 服务”打开 Pixcall 客户端,点击菜单 > 偏好设置 > 智能:

开启 LM Studio 服务开关(默认配置的 API URL 为当前设备的 LLM 服务地址,同时也支持设置为局域网里其他正在运行的 LM Studio LLM 服务)

选择 LM Studio 作为模型运行方式,并下载需要的模型

开启智能功能

完成以上步骤后,返回到 Pixcall 客户端,即可使用 AI 相关的服务。

- 在后续使用 Pixcall AI 智能相关功能时,确保 LM Studio 本地服务器正在运行。

- 当使用 LM Studio 本地 AI 服务时,智能相关功能速度和您设备的硬件有关,且需要你的设备有较高的性能,目前就算配置非常好的个人电脑跑大模型还是很吃力的,在用大模型分析文件时速度会比较慢,而且某些文件分析会很容易超时失败。